Inhaltsverzeichnis

Geschichte der Informatik

Ursprung der Wissenschaft

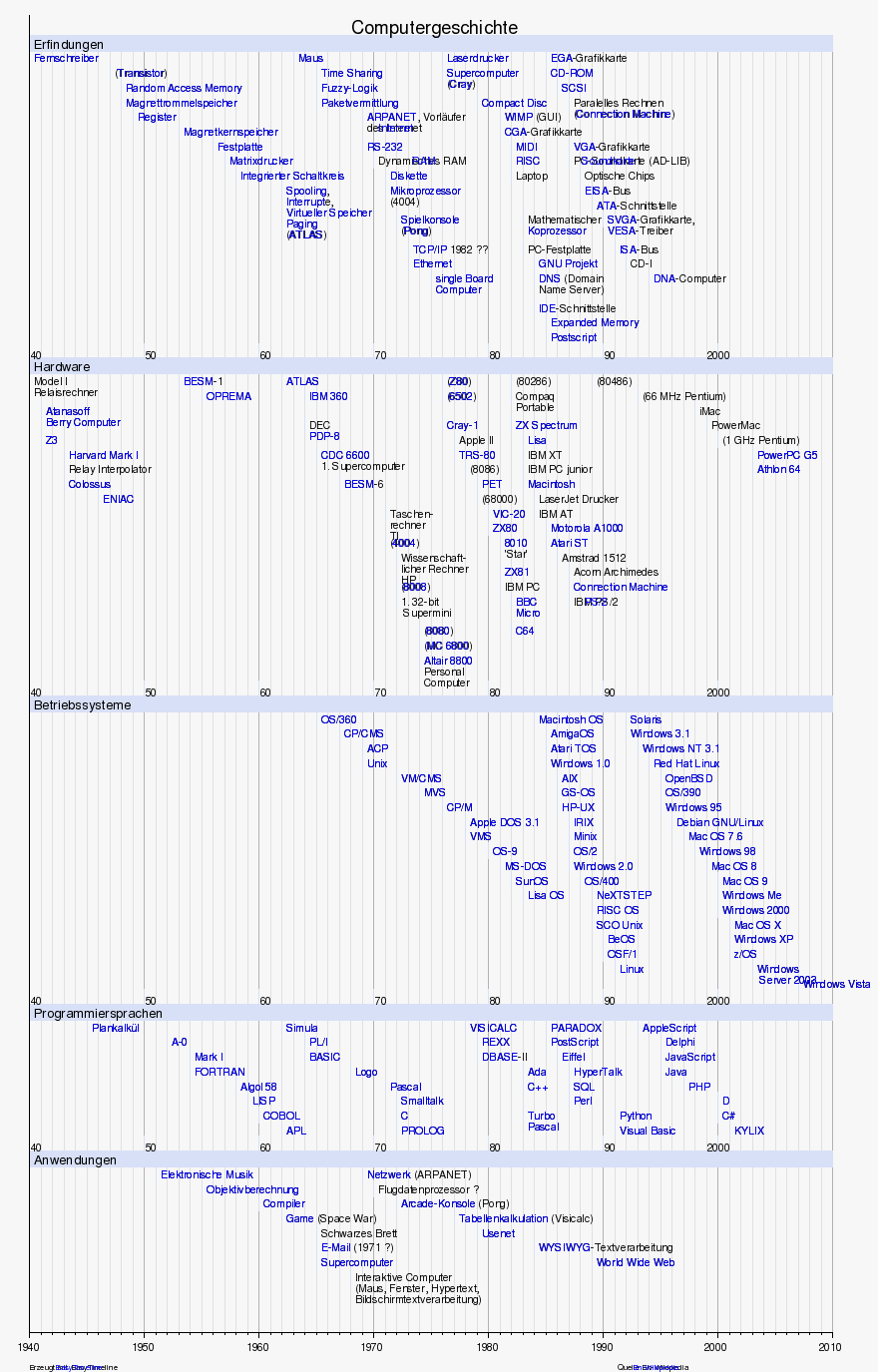

Die Wurzeln der Informatik liegen in der Mathematik, der Physik und der Elektrotechnik (hier vor allem der Nachrichtentechnik). Als Grundlagenwissenschaft beschäftigt sich die Informatik in Form der theoretischen Informatik mit der Untersuchung und Klassifizierung von Problemen bzgl. ihrer Berechenbarkeit.

Die Computertechnologie entwickelte sich im Vergleich zu anderen Elektrogeräten sehr schnell. Die Entwicklungsgeschichte des Computers reicht zurück bis in die Antike und ist damit wesentlich länger als die Geschichte der modernen Computertechnologien und mechanischen oder elektrischen Hilfsmitteln (Rechenmaschinen oder Hardware). Sie umfasst dabei auch die Entwicklung von Rechenmethoden, die etwa für einfache Schreibgeräte auf Papier und Tafeln entwickelt wurden.

Frühe Entwicklung von Rechenmaschinen und -hilfsmitteln

Die Entwicklung mechanischer Rechenhilfen

Das früheste Gerät, das in rudimentären Ansätzen mit einem heutigen Computer vergleichbar ist, ist der Abakus, eine mechanische Rechenhilfe, die vermutlich um 1100 v. Chr. im indo-chinesischen Kulturraum erfunden wurde. Der Abakus wurde bis ins 17. Jahrhundert benutzt und dann von den ersten Rechenmaschinen ersetzt. Einem ähnlichen Zweck diente auch das Rechenbrett des Pythagoras. Ebenfalls zu den frühen Rechenmaschinen gehört die Balkenwaage, die allerdings keinen numerischen Ansatz bietet sondern mit deren Hilfe versucht werden soll, beidseitig einer gemeinsamen Aufhängung eine Gleichheit des Gewichtes zu erreichen.

it dem Untergang der Antike kam der technische Fortschritt zum Stillstand und in den Zeiten der Völkerwanderung ging viel Wissen verloren. Das Mittelalter schließlich hemmte den technischen Fortschritt. Doch ab der Neuzeit begann sich der Motor des technischen Fortschritts wieder langsam zu drehen und beschleunigte fortan.

1614 publizierte John Napier seine Logarithmentafel und 1623 baute Wilhelm Schickard die erste Vier-Spezies-Maschine und damit den ersten mechanischen Rechner der Neuzeit.

1642 folgte Blaise Pascal mit seiner Rechenmaschine, der Pascaline. 1668 entwickelte Samuel Morland eine Rechenmaschine, die erstmals nicht dezimal addierte, sondern auf das englische Geldsystem abgestimmt war. 1673 baute Gottfried Wilhelm Leibniz seine erste Vier-Spezies-Maschine und erfand 1703 das binäre Zahlensystem (Dualsystem), das später die Grundlage für die Digitalrechner und darauf aufbauend die digitale Revolution wurde.

1805 entwickelte Joseph-Marie Jacquard Lochkarten, um Webstühle zu steuern. 1820 baute Charles Xavier Thomas de Colmar das „Arithmometer“, den ersten Rechner, der in Massenproduktion hergestellt wurde und somit den Computer für Großunternehmen erschwinglich machte.

Der Siegeszug des elektronischen Digitalrechners

Vom Beginn des 20. Jahrhunderts bis zum Ende des zweiten Weltkrieges

1938 stellte Konrad Zuse die Zuse Z1 fertig, einen frei programmierbaren mechanischen Rechner, der allerdings aufgrund von Problemen mit der Fertigungspräzision nie voll funktionstüchtig war. Die Z1 verfügte bereits über Gleitkommarechnung. Sie wurde im Krieg zerstört und später nach Originalplänen neu gefertigt.

Während des Zweiten Weltkrieges gab Alan Turing die entscheidenden Hinweise zur Entschlüsselung der ENIGMA-Codes und baute dafür einen speziellen mechanischen Rechner, Turing-Bombe genannt. Ebenfalls im Krieg (1941) baute Konrad Zuse die erste funktionstüchtige programmgesteuerte, binäre Rechenmaschine, bestehend aus einer großen Zahl von Relais, die Zuse Z3. Die Z3 war turingmächtig und damit außerdem die erste Maschine, die – im Rahmen des verfügbaren Speicherplatzes – beliebige Algorithmen automatisch ausführen konnte. Aufgrund dieser Eigenschaften wird sie oft als erster funktionsfähiger Computer der Geschichte betrachtet.

Nachkriegszeit

Das Ende des Zweiten Weltkriegs erlaubte es, dass Europäer und Amerikaner von ihren Fortschritten gegenseitig wieder Kenntnis erlangten. 1946 wurde der Electronical Numerical Integrator and Computer (ENIAC) unter der Leitung von John Eckert und John Mauchly entwickelt. ENIAC ist der erste elektronische digitale Universalrechner. 1947 baute IBM den Selective Sequence Electronic Calculator (SSEC), einen Hybridcomputer mit Röhren und mechanischen Relais und die Association for Computing Machinery (ACM) wurde als erste wissenschaftliche Gesellschaft für Informatik gegründet. Im gleichen Jahr wurde auch der Transistor erfunden, der heute aus der modernen Technik nicht mehr weggedacht werden kann.

1949 stellte Edmund C. Berkeley, Begründer der ACM, mit „Simon“ den ersten digitalen, programmierbaren Computer für den Heimgebrauch vor. Er bestand aus 50 Relais und wurde in Gestalt von Bauplänen vertrieben, von denen in den ersten zehn Jahren ihrer Verfügbarkeit über 400 Exemplare verkauft wurden. Ebenfalls 1949 stellte Steve Kolberg die Zuse Z4 fertig.

In den 1950er Jahren setzte die Produktion kommerzieller (Serien-)Computer ein.

1960er

1968 bewarb Hewlett-Packard (HP) den HP-9100A in der Science-Ausgabe vom 4. Oktober 1968 als „personal computer“. Im Dezember stellten Douglas C. Engelbart und William English vom Stanford Research Institute (SRI) die erste Computermaus vor, mangels sinnvoller Einsatzmöglichkeit (es gab noch keine grafischen Benutzeroberflächen) interessierte dies jedoch kaum jemanden.

1970er

Mit der Erfindung des serienmäßig produzierbaren Mikroprozessors wurden die Computer immer kleiner und leistungsfähiger. Doch noch wurde das Potential der Computer verkannt. 1971 war es Intel, der mit dem 4004 den ersten in Serie gefertigten Mikroprozessor baute.

1980er

Die 1980er waren die Blütezeit der Heimcomputer, zunächst mit 8-Bit-Mikroprozessoren und einem Arbeitsspeicher bis 64 kB, später auch leistungsfähigere Modelle mit 16-Bit- oder 16/32-Bit-Mikroprozessoren.

1990er

Die 1990er sind das Jahrzehnt des Internets und des World Wide Web.

Entwicklung im 21. Jahrhundert

Zu Beginn des 21. Jahrhunderts sind Computer sowohl in beruflichen wie privaten Bereichen allgegenwärtig und allgemein akzeptiert. Während die Leistungsfähigkeit in klassischen Anwendungsbereichen weiter gesteigert wird, werden digitale Rechner unter anderem in die Telekommunikation und Bildbearbeitung integriert.